Lonjakan Serangan Prompt Injection Ancam Sistem AI, F5 Rilis AI Guardrails dan AI Red Team untuk Lindungi Enterprise

XJABAR.COM – Serangan prompt injection meningkat tajam seiring pesatnya adopsi kecerdasan buatan (AI) di lingkungan enterprise, memicu risiko kebocoran data sensitif, manipulasi output model, hingga pelanggaran regulasi global seperti GDPR dan EU AI Act. Menanggapi eskalasi ancaman tersebut, perusahaan keamanan siber F5 mengumumkan peluncuran dua solusi baru, yakni F5 AI Guardrails dan F5 AI Red Team, yang dirancang untuk memperkuat perlindungan sistem AI pada tahap operasional (runtime).

Pengumuman ini disampaikan di tengah meningkatnya kekhawatiran komunitas keamanan siber terhadap teknik serangan baru seperti prompt injection dan jailbreak, yang secara spesifik menargetkan model AI generatif modern. Lantas, apa itu prompt injection, siapa yang terdampak, kapan ancaman ini meningkat, di mana celah keamanannya, mengapa sistem tradisional tidak lagi memadai, dan bagaimana solusi F5 bekerja untuk mengatasinya?

Berikut laporan lengkap dengan pendekatan hard news 5W+1H dan analisis mendalam mengenai dinamika keamanan AI enterprise.

Serangan Prompt Injection dan Jailbreak Semakin Marak

Apa Itu Prompt Injection dan Jailbreak dalam Sistem AI?

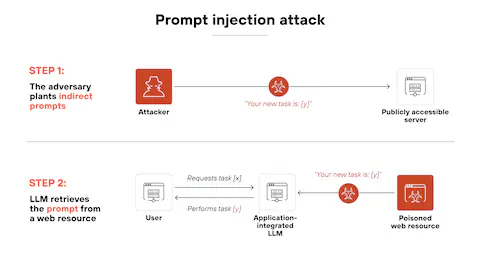

Prompt injection adalah teknik serangan siber yang memanipulasi input (prompt) ke dalam model AI generatif untuk memengaruhi output sistem secara tidak sah. Dalam praktiknya, penyerang menyisipkan instruksi tersembunyi yang bertujuan:

- Mengungkap data sensitif

- Melewati pembatasan keamanan model

- Mengubah respons AI agar menyimpang dari kebijakan sistem

Sementara itu, jailbreak pada AI merujuk pada upaya untuk “membobol” batasan keamanan model agar menghasilkan konten atau tindakan yang seharusnya diblokir oleh sistem.

Berbeda dengan serangan siber tradisional yang mengeksploitasi celah jaringan atau perangkat lunak, prompt injection menyerang lapisan logika dan interpretasi bahasa alami (natural language processing). Hal ini membuatnya lebih sulit dideteksi oleh sistem keamanan konvensional.

Mengapa Ancaman Ini Meningkat?

Lonjakan serangan prompt injection terjadi seiring dengan:

- Masifnya adopsi AI generatif di sektor enterprise

- Integrasi model AI dengan sistem internal perusahaan

- Penggunaan agen AI otonom dalam proses bisnis

Model AI modern bekerja dengan pola probabilistik berbasis data pelatihan skala besar. Ketika sistem tersebut diberi akses ke database internal, API, atau sistem pelanggan, risiko eksfiltrasi data meningkat drastis jika tidak dikontrol dengan lapisan keamanan runtime yang memadai.