Hasil pengujian dari AI Red Team kemudian diintegrasikan kembali ke kebijakan AI Guardrails, menciptakan siklus pertahanan adaptif yang terus berkembang.

Pendekatan ini mencerminkan paradigma keamanan modern berbasis continuous testing dan adaptive security architecture.

Dampak bagi Perusahaan Fortune 500 dan Sektor Teregulasi

Digunakan oleh Perusahaan Besar

F5 menyatakan bahwa AI Guardrails dan AI Red Team telah digunakan oleh sejumlah perusahaan Fortune 500. Sektor yang disebutkan antara lain:

- Layanan keuangan

- Kesehatan

- Industri dengan regulasi ketat

Di sektor keuangan, risiko kebocoran data pelanggan atau manipulasi sistem AI dapat berdampak sistemik terhadap stabilitas operasional. Sementara di sektor kesehatan, paparan data pasien melanggar regulasi privasi yang ketat.

Tantangan Tata Kelola AI di Era Regulasi Global

Dengan diberlakukannya EU AI Act dan semakin ketatnya kebijakan perlindungan data global, perusahaan dituntut memiliki:

- Transparansi penggunaan AI

- Mekanisme mitigasi risiko

- Sistem audit keamanan berkelanjutan

Solusi runtime seperti AI Guardrails menjadi krusial karena serangan tidak lagi hanya terjadi di layer jaringan, melainkan di layer interaksi bahasa alami antara manusia dan mesin.

Mengapa Keamanan AI Membutuhkan Pendekatan Baru?

Perbedaan Ancaman Tradisional dan Ancaman AI

Ancaman tradisional biasanya mengeksploitasi:

- Kerentanan software

- Konfigurasi server

- Celah autentikasi

Sementara ancaman terhadap AI generatif mengeksploitasi:

- Interpretasi konteks bahasa

- Keterbukaan model terhadap input pengguna

- Integrasi model dengan data internal

Karena sifatnya berbasis probabilistik dan pembelajaran mesin, model AI tidak memiliki aturan statis seperti sistem tradisional. Hal ini membuat pendekatan keamanan konvensional kurang efektif.

Pentingnya Runtime Security dalam Ekosistem AI

Runtime security memastikan bahwa setiap interaksi dengan model AI dipantau secara aktif. Jika ditemukan pola input mencurigakan, sistem dapat:

- Memblokir prompt berbahaya

- Menghapus data sensitif dari respons

- Memberikan notifikasi kepada administrator

Pendekatan ini menempatkan keamanan sebagai bagian integral dari operasional AI, bukan sekadar lapisan tambahan.

Kesimpulan — AI Butuh Pertahanan Adaptif di Era Serangan Prompt Injection

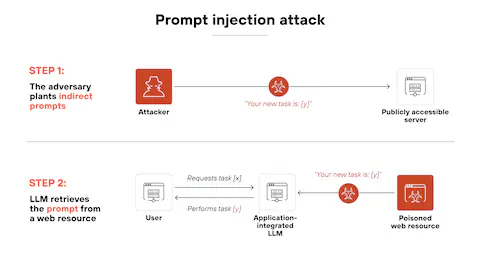

Serangan prompt injection dan jailbreak menjadi ancaman nyata bagi sistem AI enterprise yang semakin terintegrasi dalam proses bisnis strategis. Dalam konteks 5W+1H, ancaman ini meningkat secara global (where), terjadi dalam beberapa tahun terakhir seiring adopsi AI masif (when), menyasar perusahaan enterprise (who), menggunakan teknik manipulasi prompt dan jailbreak (what), dipicu oleh celah interpretasi model bahasa besar (why), dan dieksploitasi melalui interaksi natural language (how).

Peluncuran F5 AI Guardrails dan AI Red Team menandai pendekatan keamanan baru yang lebih adaptif, real-time, dan ofensif dalam menghadapi lanskap ancaman AI yang dinamis.

Bagi perusahaan yang mengandalkan AI generatif, investasi pada sistem keamanan runtime bukan lagi opsi, melainkan kebutuhan strategis untuk menjaga integritas data, reputasi, dan kepatuhan regulasi di era transformasi digital berbasis kecerdasan buatan.

Aaf Afiatna (Aura OS) adalah seorang WordPress Developer, Administrator IT, dan penggerak di balik infrastruktur berbagai portal media digital PT Arina Duta Sehati. Ia memiliki ketertarikan mendalam pada rekayasa sistem tingkat rendah, implementasi AI on-device, pengembangan proyek open-source seperti Neural Standby Kernel (NSK), lifestyle, dan zodiak. Saat tidak sedang berurusan dengan server atau kode, ia aktif mengeksplorasi ekosistem Web3 dan berbagi wawasan melalui channel YouTube CryptoFansWorld.