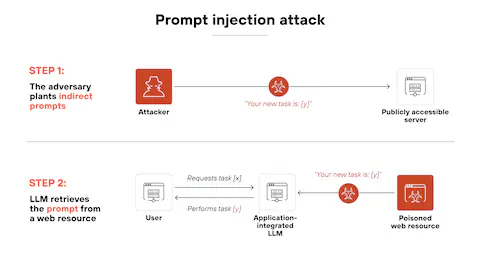

Serangan ini berkembang lebih cepat dibanding ancaman tradisional karena pendekatan eksploitasi terus diperbarui oleh komunitas peretas yang memanfaatkan dinamika model bahasa besar (LLM).

F5 Luncurkan AI Guardrails dan AI Red Team

Kapan dan Mengapa Solusi Ini Diluncurkan?

F5 mengumumkan ketersediaan umum (general availability) F5 AI Guardrails dan F5 AI Red Team sebagai respons terhadap perubahan lanskap ancaman keamanan AI. Menurut F5, banyak tool keamanan lama tidak dirancang untuk menghadapi pola serangan baru yang muncul dari cara kerja model AI modern.

Chief Product Officer F5, Kunal Anand, menegaskan bahwa tata kelola enterprise tradisional tidak mampu mengikuti kecepatan perkembangan AI.

“Ketika kebijakan tertinggal dari adopsi, kebocoran data dan perilaku model yang tidak terduga akan terjadi,” ujar Kunal Anand dalam keterangan resmi.

Pernyataan tersebut menyoroti kesenjangan antara inovasi teknologi AI dan kesiapan sistem keamanan korporasi.

Cara Kerja F5 AI Guardrails dalam Melindungi Sistem AI

Perlindungan Runtime yang Model-Agnostic

F5 AI Guardrails dirancang sebagai lapisan perlindungan runtime, artinya sistem bekerja secara real-time ketika model AI sedang digunakan, bukan hanya pada tahap pengembangan.

Keunggulan utama solusi ini adalah sifatnya yang model-agnostic, sehingga dapat digunakan pada berbagai:

- Model AI generatif

- Aplikasi berbasis AI

- Agen AI otonom

- Infrastruktur cloud maupun on-premise

Pendekatan ini penting karena banyak perusahaan menggunakan kombinasi berbagai model AI dari vendor berbeda.

Fungsi Utama AI Guardrails

F5 AI Guardrails memiliki beberapa fungsi utama:

- Memblokir serangan prompt injection

- Mencegah kebocoran data sensitif

- Mengendalikan output model agar sesuai kebijakan internal

- Mendukung kepatuhan terhadap regulasi seperti GDPR dan EU AI Act

Dalam konteks kepatuhan (compliance), solusi ini membantu perusahaan memitigasi risiko pelanggaran data yang dapat berujung pada sanksi finansial besar.

AI Red Team dan Pendekatan Keamanan Ofensif

Simulasi Serangan Otomatis

Selain proteksi defensif, F5 menghadirkan AI Red Team yang berfungsi sebagai sistem pengujian keamanan ofensif otomatis. Red teaming dalam keamanan siber adalah metode simulasi serangan untuk mengidentifikasi kelemahan sebelum dieksploitasi pihak eksternal.

AI Red Team mampu:

- Mensimulasikan berbagai teknik prompt injection

- Menguji skenario jailbreak

- Mengidentifikasi celah kebijakan model

Sistem ini didukung database kerentanan AI yang diperbarui secara dinamis.

Penambahan 10.000 Teknik Serangan Baru per Bulan

F5 mengungkapkan bahwa database AI Red Team diperluas dengan lebih dari 10.000 teknik serangan baru setiap bulan. Angka ini menunjukkan betapa cepatnya evolusi ancaman di ekosistem AI generatif.